Amazon kennt das Lieblingsbuch, Facebook die heimliche Geliebte. Im Netz werden uns ständig persönliche Empfehlungen serviert. Möglich machen das Algorithmen. Aber wie arbeiten sie? Und vor allem: Wo führt das Wissen über uns hin? Ein Beitrag von Markus Köbnik.

Große Firmen wie Amazon, Google oder Facebook rechnen mit ihrer Kundschaft. Und das wortwörtlich. Denn wer weiß, was der User anklickt, was ihn interessiert und was er gerade braucht, hat einen klaren Vorteil gegenüber der Konkurrenz. Das Ergebnis ist Werbung, die passgenau auf den Kunden zugeschnitten ist.

Die Vermessung des Nutzers

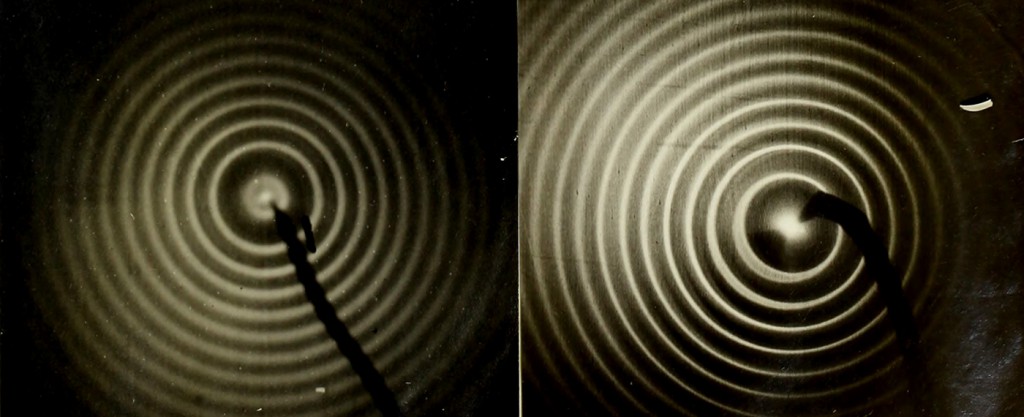

Internetnutzer werden in sozialen Netzwerken oder beim normalen Surfen im Web verfolgt, vermessen und scheinbar unbemerkt dazu verführt, spezielle Angebote anzuklicken.

Die Technik, die dahinter steckt, heißt Algorithmus. Ein Begriff, der immer wieder für Kontroversen sorgt. Algorithmen machen unser Leben leichter, sagen die einen. Algorithmen wissen alles über uns und machen uns zum gläsernen Menschen, sagen die anderen. Dabei ist der Algorithmus als Grundprinzip eine überschaubare Sache.

Ganz einfach gesagt: Ein Algorithmus ist eine Handlungsvorschrift. So etwas wie ein Sockenpaarungsalgorithmus: Reihe alle Socken auf eine Wäscheleine! Nimm den Socken, der ganz links hängt und vergleiche ihn mit dem, der ein Stück weiter rechts ist! Sind sie gleich? Paare sie! Sind sie nicht gleich, dann gehe einen Socken weiter. Das wäre ein ganz klassischer Algorithmus. (Stefan Ullrich, Informatiker, Humboldt Universität, Berlin)

Wer Windeln kauft, kauft auch Dosenbier

Heute, wo Menschen im Netz Unmengen an Daten hinterlassen, und die Rechenleistung der Computer steigt, hat sich die Arbeitsweise von Algorithmen gewandelt. Sie werden im großen Stil eingesetzt, um „Datamining“ zu betreiben. Das heißt: Umfangreiche Datensätze von Usern werden in einer „Black Box“ zusammengebracht, und Algorithmen berechnen dann, ob sich daraus bestimmte Muster erkennen lassen.

Ein Klassiker: „Menschen, die Windeln kaufen, kaufen auch Dosenbier“. Für einen Menschen nicht gerade ersichtlich oder logisch, für die Korrelationen der Maschine schon. Die Kommunikationswissenschaftlerin Miriam Meckel sieht das als ein ernsthaftes Problem. Denn je mehr Daten von einem Menschen gespeichert werden, umso mehr Schlüsse können auch daraus gezogen werden. Personenbezogene Daten sind das Öl von heute, so hat es das Weltwirtschaftsforum in Davos im Jahr 2011 formuliert.

Wir alle hinterlassen unglaublich viele Daten, wenn wir im Internet sind – und das meistens, ohne dass wir das mitbekommen. Cookies installieren sich und tracken bestimmte Dinge, die wir tun. Google speichert zum Beispiel unsere Search History. Bei Facebook stellen wir aktiv Daten, Fotos, Postings, Links, Verbindungen ein. Das ist eine Datenmenge, die wir nicht abschätzen können. (Miriam Meckel, Kommunikationswissenschaftlerin, Universität St. Gallen)

Leben in der Filter-Blase

Die Global Player im Web sind erstaunlich gut darin, immer detailliertere Informationen ihrer User zu sammeln. Informationen, die schon bekannt sind, sollen immer weiter verfeinert werden.

Kritiker sagen: Wir leben längst in einer Informations-Blase, der sogenannten „Filter Bubble“. Den Begriff hat der US-amerikanische Internet-Aktivist Eli Pariser geprägt. Er beschreibt die Filterblase als einen geschlossenen Raum im Netz, in dem man viele Sachen entdecken kann, die erstaunlich gut zu einem passen.

Zum Beispiel mit einer personenbezogenen Ergebnisseite bei einer Google Suche. Diese kann einem als bekennenden Weltenbummler zwar Ägypten als Reiseland schmackhaft machen, aber gleichzeitig Treffer zur aktuellen politischen Situation vor Ort vernachlässigen. Miriam Meckel geht davon aus, dass uns durch die Filterblase der Zufall weggenommen wird.

Wenn ich eine Zeitung aufschlage und scanne mit den Augen die Seiten ab, dann stolpere ich manchmal über einen Artikel, von dem ich gar nicht wusste, dass er mich interessieren könnte. Ich lese ihn an, finde es spannend und lese ihn zu Ende. Damit eröffne ich mir ein Thema, das ich nicht aktiv gesucht hätte. Im Internet ist das etwas schwieriger, weil wir da aktiv suchen müssen, um etwas zu finden. Oder wir werden auf die personalisierten Suche zurück geworfen, also auf die Algorithmen, die uns einrechnen. Wir bekommen also nur das angeboten, was wir sowieso mögen und nicht das, wovon wir noch nichts wussten. (Miriam Meckel, Kommunikationswissenschaftlerin, Universität St. Gallen)

Wie mit der Vermessung im Netz umgehen? Es gibt Menschen, die sich heute in digitaler Selbstverteidigung üben, aber auch Menschen, die sich voll auf das gefilterte Leben einlassen und ihre Daten ganz bewusst nicht schützen.

Informatik und Ethik

Der Informatiker Stefan Ullrich plädiert für mehr Ethik in der Informationstechnologie. Denn es sind nicht die Algorithmen, die die Macht haben, unser Verhalten vorherzusagen, es sind die Menschen und Unternehmen, die sie einsetzen. Seine Kritik bezieht sich auch auf Informatiker, die entsprechende Codes programmieren.

Informatiker machen es sich sehr oft sehr einfach, indem sie sagen: Ich mach nur die Technik, ich hab damit nichts zu tun. Wer das einsetzt, ist dafür moralisch verantwortlich. Dieses Gut/Böse und Schwarz/Weiß gibt es nicht in der Ethik, und schon gar nicht gibt es einen Algorithmus für Ethik. (Stefan Ullrich, Informatiker an der Humboldt Universität Berlin)

Wie viel Berechnung soll künftig erlaubt sein? Gibt es im Internet eigentlich ein Recht auf Vergessen? Und wie können Menschen erfahren, was Firmen über sie berechnen und speichern?

Eins ist klar: Datenschutz muss heute neu gedacht werden. In Kalifornien wird gerade schon über den „Right to Know Act“ debattiert. Einen Gesetzesentwurf, der Nutzern umfangreiche Auskunftsrechte gegenüber sozialen Netzwerken und deren Geschäftspartnern ermöglichen soll – sehr zum Missfallen der großen Internet-Konzerne.

Literatur-Tipps

Christopher Steiner, Automate This: How Algorithms Came to Rule Our World, Portfolio, 2012

Christian Heller, Post Privacy. Prima Leben ohne Privatssphäre, Beck, 2011

Miriam Meckel, NEXT: Erinnerungen an eine Zukunft ohne uns, Rowohlt, 2011

Eli Pariser, Filter Bubble: Wie wir im Internet entmündigt werden, Carl Hanser Verlag, 2012

Steffan Heuer und Pernille Tranberg, Mich kriegt ihr nicht! Gebrauchsanweisung zur digitalen Selbstverteidigung, Murmann, 2013

Den Originalartikel mit zahlreichen Zusatzinformationen und Klicktipps finden Sie auf den Seiten des Bayerischen Rundfunks.

Last Comments